Pour programmer Unity pour des casques de réalité virtuelle Oculus, il est recommandé de construire son programme à partir de composants déja codés automatisant la gestion d'un certain nombre de tâches. Ces "assets" doivent être récupérés et importés dans chaque projet que nous créérons.

Importer Oculus Integration

Vous êtes actuellement dans l'onglet Scene. Dans une fenêtre d'exploration de fichiers allez dans le répertoire c:\unityassets\assets (nom inexact mais proche) et copiez-collez le sous-répertoire "oculus" qui s'y trouve dans le répertoire assets de votre projet. Nous avons prétéléchargé pour vous cet asset Oculus Integration dans la version 18 (nécessaire à notre installation). Vous remarquerez que le répertoire oculus apparait alors dans la fenêtre Project et dans les assets, montrant la hiérarchie de nos ressources. Dans la vue principale revenez sur l'onglet Scene après l'import.

Préparer la scene

Nous disposons maintenant de components (créés par des scripts) déjà écrits et prêts à être utilisés. Nous allons commencer à les utiliser. Tout d'abord ajouter un OVRCameraRig dans la scene, puis déplacer la caméra traditionnelle sous ce OVRCameraRig dans le panneau de hiérarchie de scène.

Créez la scène simple suivante : une pièce carré avec un sol et 4 murs épais, sans toit. Nommer chacun des objets de la scene avec des noms pertinents.

Compiler le projet et lancer sur le casque

Depuis la création du programme jusqu'au lancement de notre projet sur le casque, les étapes sont : Compilation => Création d'un fichier appli android .APK => Téléchargement du .APK sur le casque (par le cable USB) => lancement du .APK sur le casque (automatique la première fois après compilation)

Pour compiler notre projet, aller dans le menu File > Build Settings. Si notre scene n'est pas listée dans l'encadré appuyer sur Add Open Scene pour l'y ajouter. Décochez la scene par défaut SampleScene. Choisir la plateforme Android et appuyer sur switch platform pour valider. Changez également l'option de compilation "gradle" en "internal".

Aller dans le menu Edit > Project Settings > Player (ou directement par son bouton dans l'écran Build Settings). Dans l'inspector qui apparait, modifier dans Other Settings l'option Minimum API level et la mettre à API level 23, et choisissez un nom pour votre application (remplacer Productname). Enfin dans XR Settings choisir pour Virtual Reality SDK = Oculus.

Revenir dans File > Build Settings et lancer enfin Build and Run, qui vous demandera de choisir un nom pour le fichier apk à produire. Si un message annonce que le casque n'est pas détecté, vérifiez qu'il est bien branché par son cable et enfilez le casque pour donner les authorisations demandées au PC. S'il n'y a plus d'erreur de compilation, le fichier APK sera généré sur disque, puis copié vers et lancé dans le casque. Le fichier apk peut être retrouvé plus tard dans la section Bibliothèque>source inconnue de l'environnement Oculus.

Résumé de la procédure :

- File > Build Settings

- Vérifier que sa scène est selectionnée

- Android + switch platform

- Compilation : internal à la place de gradle

- Player Settings

- Other Settings

- nom unique pour son application (com.oculus.monnomunique)

- min API level 23

- XR Settings

- Virtual Reality SDK = Oculus

- Other Settings

- File > Build Settings

- build and run => casque non détecté => donner l'autorisation en mettant le casque

- build and run => chargement et lancement automatique de l'appli sur le casque => enjoy !

Documentation

Documentation Unity de référence : Unity Developer Guide for Oculus

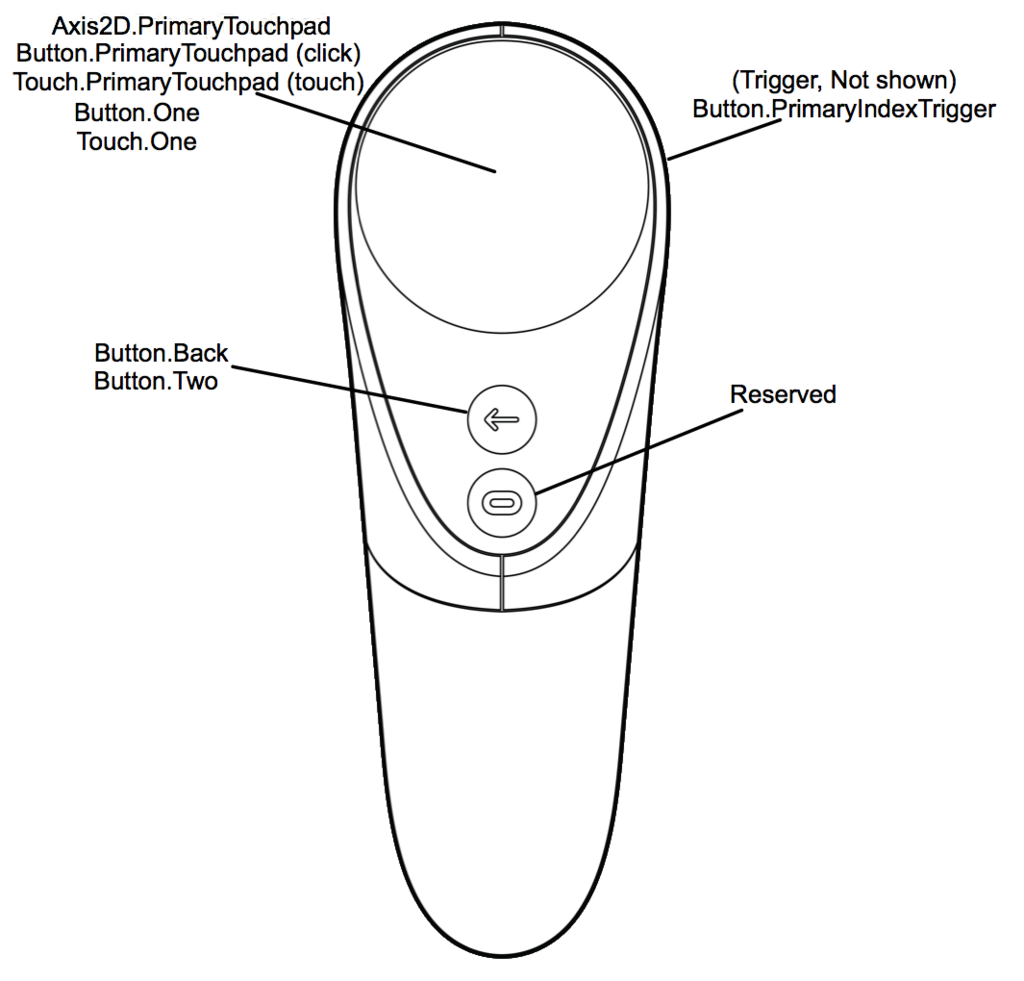

Documentation sur la gestion des controllers tenus en main : OVRInput

Nous voulons à présent ajouter un objet représentant le joueur dans la scène et le diriger grâce aux inputs du controller de l'Oculus Go tenu en main.

Création de l'avatar

Ajouter un GameObject Sphere à la verticale du centre de votre pièce. Changer son nom pour Player. Compiler et lancer sur le casque.

Ajouter maintenant à Player un component Physics>RigidBody. Compiler et lancer sur le casque.

Diriger l'avatar avec le controller

Pour ajouter un comportement à l'objet Player nous allons écrire un script C#.

Ajouter un nouveau script à Player. Nommer le script "ControllerBehaviour" (comportement du controller). Unity associe un component à ce script. Pour l'instant éditer le script. Dans ce script nous allons expliquer comment l'avatar (Player) va bouger selon les commandes du controller. Il contient un code minimal que nous allons enrichir.

Commencer par ajouter des instructions dans la fonction Update() pour que la balle saute verticalement lorsqu'on appuie sur la gachette du controller. La position de l'objet courant (la balle) est obtenue en accédant à transform.position et un vecteur se définit en Vector3.Testez votre résultat dans le casque.

Nous souhaitons ensuite paramétrer la hauteur du saut dans l'interface Unity. Pour cela, ajouter dans le script un champ privé réel : jumpHeight, précédé de la mention [SerializeField] pour qu'il devienne visible dans l'interface du component correspondant. Tenez en compte ensuite pour régler la hauteur du saut.

Diriger maintenant la balle avec le touchpad sur la partie haute du controller. On pourra utiliser Vector3.right et Vector3.forward pour les directions principales de mouvement. La vitesse du mouvement sera un paramètre speed réglable dans l'interface.

Vue à la troisième personne

La caméra (notre point de vue) est statique dans la scène. Si l'on veut qu'elle suive la balle (le Player) en vue à la troisième personne, il faut attacher la caméra au Player. Déplacer dans la vue hiérarchique le OVRCameraRig pour le placer en fils du Player et constater le résultat dans le casque.

Vers un labyrinthe...

Modifier votre scène pour ajouter une deuxième pièce avec un couloir entre les deux. Utiliser les outils de rotation pour faire en sorte que les deux pièces ne soient pas à la même hauteur et que le couloir les reliant soit un plan incliné. Observez dans le casque le comportement de la balle lorsque vous tentez de monter la pente.

Lorsqu'on contrôle la balle, nous souhaitons désactiver le calcul de la vitesse par le moteur physique pour imposer nos directives. Récupérez cette vitesse en accédant au champ velocity de l'objet retourné par GetComponent<Rigidbody>() et mettez la à zéro chaque fois qu'on dirige la balle.

Orienter sa vue autour de l'avatar

Pour orienter la vue autour de notre avatar nous allons commander un mouvement en orbite autour de l'avatar, dirigé par l'orientation de la tête de l'utilisateur. La caméra (OVRCameraRig) étant maintenant attachée à la balle (sous la balle dans la hiérarchie), cette orientation sera décidée dans le même script que précédemment, le script comportement de la balle. L'idée est de faire tourner la balle pour réorienter la Camera, qui est solidaire de la balle mais éloignée d'elle.

Vous pouvez récupérer l'orientation de la tête en consultant cette page (choisir l'api version 2018.4) et en appliquant la méthode appropriée au noeud UnityEngine.XR.XRNode.Head. L'angle de rotation qui nous intéresse est le lacet (yaw en anglais). Les autres angles (tangage = pitch, et roulis = roll) ne seront pas utilisés ici.

Remarque : pour le confort de l'utilisateur il est préférable que la vue ne tourne pas à la moindre réorientation de la tête. Pour des angles inférieurs à 20 degrés, ne tournez pas la vue.

Que constatez-vous pour la direction de vos mouvements si vous tournez la vue à 180 degrés par exemple ? Essayez de corriger le problème.